Герберт Уеллс назвав його Всесвітнім мозком. Одного разу, як він сподівався, мудрі люди створять «мозок сучасної спільноти, велику енциклопедичну організацію, яка постійно оновлюється та дає приблизні оцінки та напрямки для всієї матеріальної діяльності людства».

Хіба це не схоже на сучасну мережу, точніше, на Вікіпедію?

Веллс сподівався, що його Всесвітній мозок допоможе зміцнити глобальну єдність і зміцнити мир. Але сучасний світовий мозок зовсім не гармонійний. Вікіпедія роздроблена на справедливі бульбашки люті, нескінченний аргумент. Це стало реальним втіленням притчі про Вавилонську вежу, де Бог карає за гордість людини, гарантуючи, що ми більше не можемо розуміти один одного.

Ми перебуваємо на полі інформаційної битви, де створювати погане й фальшиве настільки легко, що воно заглушає хороше й правдиве.

Це не щасливе місце, але минулого року новачок зробив його ще більш тривожним: остання версія штучного інтелекту у формі нових генераторів тексту та зображень. Експерти прогнозують, що незабаром більша частина Інтернету буде створена штучно за допомогою цих великих мовних моделей. Найвідомішим є ChatGPT.

Поява цієї технології спонукала прихильників штучного інтелекту хвилюватися про екзистенціальні загрози. Але що, якщо справжня проблема зі штучним інтелектом є чимось набагато більш безпосереднім і буденним: що, якщо світ, який він створює, є більш однорідним і нудним? Що, якщо замість більшої різноманітності, багатства та якості нові інформаційні інструменти створять світ більшої відповідності та м’якості? Що робити, якщо штучний інтелект не стимулює нас думати про світ по-новому, а справді гасить ідеї?

Дослідники та критики вже стурбовані. Їх особливе занепокоєння полягає в тому, що результати нових текстових генераторів штучного інтелекту вводяться в моделі, які їх живлять, як навчальні дані, які допомагають формувати їхні відповіді. Це канібальний процес. І це створює те, що інженери визнали дуже давно: цикл зворотного зв’язку.

Подумайте про Уробороса, змія стародавньої міфології, який пожирав власний хвіст. Або подумайте про схрещування, аналогію, використану дослідником штучного інтелекту Університету Монаша Джатаном Садовським, який називає його «ШІ Габсбургів», на честь іспанської монархії, де інцестуальні стосунки призводили до генетичних деформацій, поганого здоров’я та, зрештою, безпліддя.

Ніколас Насім Талеб, автор бестселерів, попередив, що штучний інтелект «все частіше включатиме СВОЮ ВЛАСНУ продукцію (безпосередньо та з інших рук)». Він зауважив у X, раніше відомому як Twitter: «Ви публікуєте щось, що взяв із нього, і він використовуватиме це для зміцнення власних знань».

Якщо дозволити цьому статися, Талеб вважає, що штучний інтелект створить «самозлизувальний льодяник» — щось, єдине призначення якого — служити самому собі. Термін відноситься до самовідновлюваної організації, яка не має іншої мети, окрім свого продовження.

Сер Найджел Шедболт, виконавчий голова Інституту відкритих даних, попереджає про перші ознаки того, що це вже відбувається: штучний інтелект отруює власні запаси їжі, сказав він у Evening Standard, посилаючись на результати нових моделей, які пишуть комп’ютерний код, який виробляє гірше. результатів, ніж очікувалося.

Кілька десятиліть тому медіазнавець Маршалл Маклюен попередив нас: «Ми формуємо інструменти, а інструменти формують нас». Виникає запитання, як штучний інтелект формуватиме світ?

Культурний мешап

Термін «штучний інтелект» існує вже майже 70 років. Показовість і перебільшення супроводжують його від самого народження.

Полум’яний американський математик, який ввів цей термін і організував першу в історії конференцію зі штучного інтелекту, професор Массачусетського технологічного інституту Джон Маккарті, пізніше зізнався, що «винайшов його, коли ми намагалися отримати гроші на літнє навчання».

Пізніше Маккарті згадував, що колега застеріг його від використання такого амбітного виразу, оскільки воно було «надто кричущим». Але ребрендинг творив чудеса, і гроші хлинули. І тому створення машин, які можуть міркувати та мислити так само, як ми, або, можливо, навіть краще, стало ще однією з великих післявоєнних наукових спроб.

Дональд Фаган зі Steely Dan передав цю впевненість у своїй пісні IGY, згадуючи оптимізм наукового ярмарку 1958 року: «Справедлива машина для прийняття важливих рішень / Запрограмована співчуттям і далекоглядністю / Ми будемо чистими, коли їхню роботу буде зроблено / Ми Буду вічно вільним і вічно молодим».

Здається, до успіху ще далеко, але хвилюватися не варто, передбачають експерти. «Машини будуть здатні протягом 20 років виконувати будь-яку роботу, яку може виконувати людина», — передбачив теоретик, лауреат Нобелівської премії Герберт Саймон у 1960 році.

От тільки не зовсім вийшло. Усі спроби закінчувалися провалом. На рубежі 1970-х років фінансування скоротилося, і штучний інтелект майже 40 років був у собачій будці. Потім, десять років тому, все почало покращуватися.

Інженери штучного інтелекту запропонували спиратися на статистичні припущення, щоб дати нам імітацію інтелекту. Моделі були розроблені та ускладнені, а також отримали доступ до більшої потужності комп’ютера та значно більшої кількості даних.

Вони проковтнули величезну кількість фотографій, які могли знайти в Інтернеті, і витягли якомога більше з усіх документів, які змогли знайти. Авторське право не вважалося перешкодою – рішення, яке зараз виглядає як дорога авантюра. Імітації ставали все кращими. Вони навіть стали корисними.

За останні кілька років ці методи, які називаються машинним навчанням або глибоким навчанням, змінили мовний переклад і покращили фотографії, які ми знімаємо за допомогою наших смартфонів. Алгоритми чудово оживляють минуле, очищаючи стародавні кадри фільму та роблячи їх гладкими, як сучасний фільм.

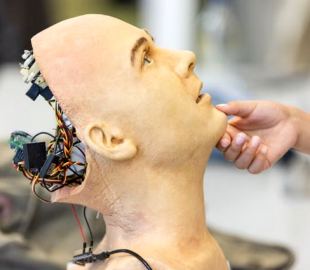

Сучасний генеративний штучний інтелект, заснований на великих мовних моделях (LLM), є кульмінацією всієї цієї роботи. Його навчили підробляти людські голоси, вірші, прозу, комп’ютерний код чи мистецтво. Але це не інтелект.

Він створює суміш світу на основі математичних припущень і не розуміє, що робить. За словами автора Теда Чіанга, чиє оповідання перетворили на оскароносний фільм «Прибуття», це не що інше, як «прикладна статистика».

Обчислення настільки хороші, наскільки добре використано моделлю та навчилося імітувати. ChatGPT може звучати так, ніби він розбирається в дечому, але він лише впевнений блеф.

Поглинаючи хитрі дані та викидаючи їх назад, ці моделі створюють нову проблему: петлі зворотного зв’язку. Прикладом того, як легко це може статися, є історія Тайлера Коуена. Коуен — американський професор економіки та блогер із відданими прихильниками в Інтернеті, включаючи прем’єр-міністра Ріші Сунака.

Ковена вихваляють у друкованих профілях за його всеїдне читання та ретельний і старанний підхід. Однак минулого року він зробив дуже дивну заяву. Коуен стверджував, що Френсіс Бекон, видатний англійський державний діяч і філософ і головна постать у зародженні сучасної наукової революції, вороже ставився до друкарського верстата.

На підтвердження цього Коуен навів пряму цитату з Бекона. Брови були підняті. Ворожість до нової технології друку, здавалося, не відповідала такій ключовій фігурі Просвітництва, яка назвала її одним із трьох великих винаходів епохи Відродження поряд із компасом і порохом.

Журналіст Метью Інґрем зауважив, що цитата Бекона, яку використав Коуен, більше ніде не існує, і жоден вчений не підтвердив його твердження. Інграм та інші припустили, що помилка могла бути згенерована ChatGPT, яку Коуен хвалив.

Щоб перевірити, чи було завдано довготривалої шкоди, журналіст The Nation запитав ChatGPT про погляди Френсіса Бекона на друкарський верстат. Чат-бот впевнено наполягав, що Бекон проти. Спантеличений журналіст наполягав. Знадобилося чотири спроби, щоб переконати чат-бота визнати, що насправді це не думка «більшості»; жодних доказів цього твердження не можна знайти ні в одному з власних творів Бекона. Тим не менш, брехня взула чоботи і пішла по світу.

«Карколомне розгортання недоробленого штучного інтелекту та його бездумне прийняття купою довірливих авторів означає, що Google більше не є надійною відправною точкою для досліджень», – підсумувала журналіст Марія Бустільос.

У справі Бекона неправда штучного інтелекту замінила справжню правду, а професор Коуен потенційно зіграв певну роль у зміні нашого уявлення про головну історичну постать. Неправда тепер така ж незмивна, як татуювання.

(Коуен не відповів на прохання про коментар. Його публікацію в блозі про Бекона та друкарський верстат було видалено після того, як Інграм підкреслив проблеми з цитатами.)

Збожеволіти

Можливо, пристрасть Коуена до ШІ засліпила його. Коли Кріс Хауелл, доцент, який викладає на уроках релігієзнавства в Університеті Ілона в Північній Кароліні, дав кожному зі своїх 63 студентів есе, згенероване ChatGPT, він виявив дещо цікаве. Запрошений знайти помилки, кожен з його студентів виявив, що їхні есе містять вигадки. Якщо відмовитися від віри в те, що ChatGPT насправді розумний, його помилки стають дуже очевидними.

Інформаційні системи Інтернету не такі дискримінаційні.

«Коли Інтернет переповнений фальшивими цитатами, вони надають певну форму «доказів», на яких навчатимуться нові моделі штучного інтелекту», — пояснює Еммануель Маджіорі, колишній розробник програмного забезпечення та автор книги «Розумний, поки не стане дурним» про обмеження генеративний ШІ.

Філіп Пєкнєвскі, робототехнік і критик штучного інтелекту, погоджується: «Чим більше даних витікає та стає частиною Інтернету, тим більше це створює цикл зворотного зв’язку. Фальшиву фразу можна повторити тисячу разів, і ШІ вірить, що це реальність».

Маджорі зазначає, що це має практичні наслідки: це може стати смертельним ударом надії на те, що ШІ автоматизує повторювані завдання кодування.

«Новіший ШІ навчатиметься на гіршому коді, ніж раніше», — каже він. Це проблема, тому що мовна модель не має концепції правильного і неправильного, істинного чи хибного, чи жування та відригування. Воно рабськи наслідує те, що бачить.

«Ми спостерігаємо за руйнуванням систем передачі інформації, якими ми їх знаємо», — вважає Пєкнєвський.

Феномен невдачі штучного інтелекту, оскільки він задихається власним результатом, має кілька назв. Найнауковіший із них, використаний сером Найджелом Шедболтом, — це «крах моделі».

Інший — «MAD», явне посилання на хворобу коров’ячого сказу, яка була спричинена тим, що корови їли сировину, що містить мозкову речовину великої рогатої худоби. Це абревіатура, яка розшифровується як модель розладу аутофагії, і була створена в статті під назвою Self-Consuming Generative Models Go MAD дослідниками з університетів Райса та Стенфордського університету.

«Скажімо, у вас є один мільярд природних даних і один фрагмент синтетичних даних. БЕЗУМНОГО не буде. Але через рік, якщо у вас є один мільярд синтетичних даних, то, безумовно, це зійде з розуму за п’ять ітерацій», — сказала Сіна Алемохаммад, провідний автор статті, у блозі Futurism.

Керівник OpenAI Сем Альтман прогнозує, що «незабаром усі дані будуть синтетичними» - іншими словами, даними, створеними штучним інтелектом, - MAD є зловісним попередженням.

Сьогодні феноменом зворотного зв’язку нехтують, але в 1950-х роках це була найпопулярніша теорія в місті. Воно стало незмінним модним словом менеджменту десятиліття та спровокувало змагання надпотужностей: за прогнозами експертів, той, хто розуміє зворотний зв’язок, контролює майбутнє галузі.