Посилення відтоку поляризаційного та оманливого вмісту може ускладнити визначення правди — завдаючи шкоди політичним кандидатам, військовим лідерам і зусиллям з надання допомоги. Експерти з дезінформації кажуть, що швидке зростання цих сайтів викликає особливе занепокоєння напередодні виборів 2024 року.

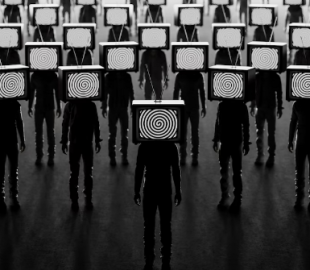

ШІ перетворився на «суперрозповсюджувач дезінформації»

Штучний інтелект автоматизує створення фейкових новин, стимулюючи вибух веб-контенту, що імітує фактичні статті, які натомість поширюють неправдиву інформацію про вибори, війни та стихійні лиха.

Історично пропагандистські операції покладалися на армії низькооплачуваних працівників або добре скоординовані розвідувальні організації для створення сайтів , які здавалися законними< /span>. Але штучний інтелект спрощує майже будь-кому — співробітнику шпигунського агентства чи просто підлітку — створювати такі виходи, створюючи контент, який часом важко відрізнити від справжніх новин.

В одній зі згенерованих штучним інтелектом статей розповідалося про вигадану історію про психіатра Біньяміна Нетаньяху, яке показало розслідування NewsGuard, стверджуючи, що він помер і залишив записку, яка свідчить про причетність прем’єр-міністра Ізраїлю. Психіатра, здається, не існує, але ця заява була представлена в іранському телешоу, була повторно поширена на арабських, англійських та індонезійських медіа-сайтах і поширена користувачів у TikTok, Reddit та Instagram.

«Деякі з цих сайтів генерують сотні, якщо не тисячі статей на день», — сказав Джек Брюстер, дослідник NewsGuard, який проводив розслідування. «Ось чому ми називаємо це наступним великим суперрозповсюджувачем дезінформації».

Генеративний штучний інтелект започаткував еру, коли чат-боти, розробники зображень і клонувальники голосу можуть створювати вміст, який здається створеним людиною.

Добре одягнені ведучі новин, створені штучним інтелектом, вивергають прокитайську пропаганду, посилену мережами ботів, які симпатизують Пекіну. У Словаччині політики, які збираються на вибори, виявляють, що їхні голоси клонуються, щоб говорити суперечливі речі, які вони ніколи не виголошували, за кілька днів до того, як виборці пішли на виборчі дільниці. Зростає кількість веб-сайтів із загальними назвами, як-от iBusiness Day або Ireland Top News, які розміщують фейкові новини, які виглядають справжніми, десятками мов від арабської до тайської.

Сайт також містить есе, написані експертом аналітичних центрів з Близького Сходу, юристом із гарвардською освітою та виконавчим директором сайту Моїдом Пірзадою, ведучим телевізійних новин із Пакистану. (Пірзада не відповів на запит про коментарі. Двоє учасників підтвердили, що вони написали статті, які з’являються на Global Village Space.)

Але разом із цими звичайними історіями є статті, згенеровані штучним інтелектом, сказав Брюстер, наприклад, матеріал про психіатра Нетаньяху, який був перейменований як «сатира» після того, як NewsGuard звернувся до організації під час свого розслідування. NewsGuard каже, що історія, схоже, була заснована на сатиричному творі, опублікованому в червні 2010 року, в якому містилися аналогічні заяви про смерть ізраїльського психіатра.

Поєднання реальних і створених штучним інтелектом новин робить оманливі історії правдоподібнішими. «У вас є люди, які просто недостатньо медіаграмотні, щоб знати, що це неправда», — сказав Джеффрі Блевінс, експерт із дезінформації та професор журналістики в Університеті Цинциннаті. «Це вводить в оману».

Веб-сайти, подібні до Global Village Space, можуть поширитися під час виборів 2024 року, ставши ефективним способом розповсюдження дезінформації, вважають медіа та експерти зі штучного інтелекту.

NewsGuard знаходить створені штучним інтелектом сайти шляхом сканування на наявність повідомлень про помилки або іншої мови, яка «вказує на те, що контент був створений інструментами штучного інтелекту без належного редагування», — кажуть в організації.

Мотиви створення таких сайтів різні. Деякі з них мають на меті вплинути на політичні переконання чи сісти хаос. За словами Брюстера, інші сайти випускають поляризований вміст, щоб залучити кліки та отримати дохід від реклами. Але можливість турбонаддуву підробленого контенту становить значний ризик для безпеки, додав він.

Технології вже давно підживлюють дезінформацію. Напередодні виборів 2020 року східноєвропейські ферми тролів — професійні групи, які займаються пропагандою — створили велику аудиторію у Facebook, поширюючи провокаційний контент на сторінках темношкірих і християнських груп, охоплюючи 140 мільйонів користувачів на місяць.

Журналістські сайти з рожевою слизом, названі на честь м’ясного побічного продукту, часто з’являються в невеликих містах, де зникли місцеві новинні видання, створюючи статті, які приносять користь фінансистам, які фінансують операцію, за словами медіа-наглядача Пойнтера.

Але Блевінс сказав, що ці методи більш ресурсомісткі порівняно зі штучним інтелектом. «Небезпека полягає в розмаху та масштабі ШІ... особливо в поєднанні з більш складними алгоритмами», — сказав він. «Це інформаційна війна такого масштабу, якого ми ще не бачили».

Незрозуміло, чи використовують спецслужби новини, згенеровані ШІ, для кампаній впливу за кордоном, але це викликає серйозне занепокоєння. «Я б зовсім не був шокований, що це буде використано — точно наступного року з виборами», — сказав Брюстер. «Важко не побачити, як якийсь політик створив один із цих сайтів, щоб створювати неправдиву інформацію про себе та дезінформацію про свого опонента».

Блевінс сказав, що люди повинні стежити за підказками в статтях, «червоними прапорцями», такими як «справді дивна граматика» або помилками в побудові речень. Але найефективнішим інструментом є підвищення медіаграмотності серед пересічних читачів.

«Повідомте людям, що існують такі сайти. Ось яку шкоду вони можуть завдати», – сказав він. «Але також визнайте, що не всі джерела однаково надійні. Те, що щось претендує на сайт новин, не означає, що у них насправді є журналіст, який створює контент».

Регулювання, додав він, значною мірою не існує. Урядам може бути важко боротися з фейковим новинним контентом через страх порушити захист свободи слова. Це залишає справу компаніям соціальних медіа, які поки що не зробили належної роботи.

Неможливо швидко впоратися з величезною кількістю таких сайтів. «Це дуже схоже на гру «вдари крота», — сказав Блевінс.

«Ви помічаєте один [сайт], закриваєте його, а інший створюється в іншому місці», — додав він. «Ти ніколи не наздоженеш це повністю».