ИИ стал создавать абсолютно реалистичные фотографии людей

Искусственный интеллект развивается с поразительной скоростью – настолько быстро, что зачастую трудно отследить. Однако есть одна область, где прогресс слишком уж явен - использование нейронных сетей для создания фейковых изображений, сообщает The Verge.

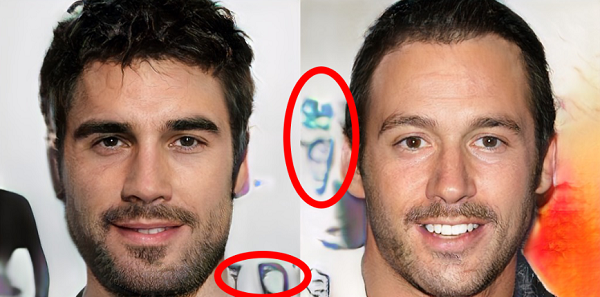

На этой картинке - четырехлетний прогресс в создании изображений искусственным интеллектом. Слева – фото, сгенерированные ИИ в 2014 году с помощью генеративно-состязательной сети (GAN), справа – изображения, созданные в этом месяце.

Эти реалистичные лица - работа исследователей из Nvidia. В своей статье, опубликованной на прошлой неделе, они описывают изменение базовой архитектуры GAN для создания изображений. Посмотрите на фотографии ниже. Если бы вы не знали, что они фейковые, могли бы вы заметить разницу?

Что особенно интересно, эти поддельные лица также можно легко модифицировать. Инженеры Nvidia использовали метод, известный как "передача особенностей" - характеристики одного изображения смешиваются с другим. Этот же метод используется в таких популярных приложениях, как Prisma и Facebook.

Применение "передачи особенностей" к созданию фейковых изображений лиц позволило исследователям Nvidia модифицировать процесс генерирования. В таблице ниже вы можете увидеть это в действии. Исходное изображение реального человека (верхний ряд) имеет черты лица другого человека (правая колонка), наложенные на него. Особенности, такие как кожа и цвет волос, смешиваются вместе, создавая то, что кажется совершенно новым человеком.

Конечно, умение ИИ создавать реалистичные фейковые лица вызывает озабоченность у многих экспертов, поскольку эти инструменты могут использоваться для дезинформации и пропаганды, могут подорвать доверие общественности к графическим доказательствам, а сама тенденция может нанести ущерб как системе правосудия, так и политике.

С одной стороны, способность создавать лица получила особое внимание в сообществе ИИ. Вы не сможете сфабриковать любое изображение с той же точностью – есть серьезные ограничения. Исследователи Nvidia потратили неделю на обучение своей модели на восьми графических процессорах Tesla, чтобы создать эти лица.

Есть несколько подсказок, благодаря которым можно обнаружить подделку. Художник и программист Кайл Макдональд перечислил ряд советов: волосы, например, очень сложно подделать – они часто выглядят слишком ровными, будто нарисованные кистью, или слишком размытые.

Также ИИ не может воссоздать человеческую симметрию лица – ИИ размещает уши на разных уровнях или делает глаза разных цветов.

Кроме того, искусственных интеллект пока не справляется с созданием текста или чисел, которые выглядят, как неразборчивые кляксы.

К счастью, эксперты уже думают о новых способах аутентификации цифровых фотографий. Некоторые решения уже есть - например, приложения для камер, которые помечают снимки геокодами, чтобы проверить, когда и где они были сделаны. В течение десятилетий будет битва между фейками искусственного интеллекта и аутентификацией изображений. И на данный момент ИИ решительно выходит в лидеры.