Facebook заблокировал около 600 млн фейковых аккаунтов

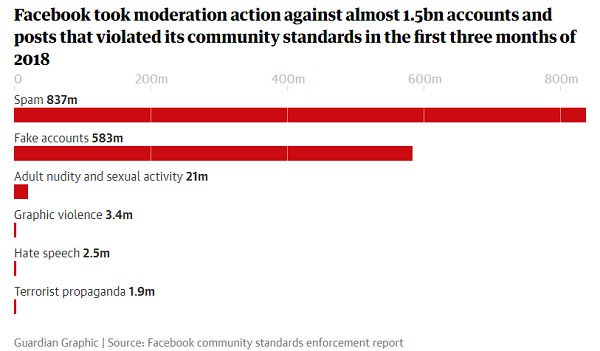

Компания Facebook заблокировала почти 1,5 млрд аккаунтов и публикаций, нарушивших стандарты за первые три месяца 2018 года. Об этом сообщает The Guardian.

В своем первом ежеквартальном отчете о соблюдении стандартов Facebook заявил, что подавляющее большинство ограничительных мер было предпринято против спама и фейковых аккаунтов: компания заблокировала 837 млн рассылок спама и 583 млн поддельных профилей на сайте за три месяца. Facebook также модерировал 2,5 млн агрессивных высказываний, 1,9 млн публикаций с террористической пропагандой, 3,4 млн сцен насилия и 21 млн постов с нежелательным контентом.

"Это только начало. Мы стараемся быть как можно более открытыми", - прокомментировал вице-президент Facebook по вопросам государственной политики в Европе, на Ближнем Востоке и в Африке Ричард Аллан.

Количество контента, модерируемое Facebook, зависит как от способности компании находить и воздействовать на материал, нарушающий авторские права, так и от численности пользовательских публикаций. Например, по словам вице-президента компании по аналитике данных Алекса Шульца, количество модерируемого контента сцен насилия почти утроилось за первый квартал.

Одной из причин, по мнению Шульца, можно назвать последние негативные события в Сирии. "Очень часто, когда в мире происходят ужасные вещи, многие обсуждают их Facebook", - утверждает Алекс.

Несколько категорий нарушений, изложенных в руководящих принципах модерации Facebook, - в том числе изображения сексуальной эксплуатации детей, интимные фото и видео, выкладываемые в сеть обиженной "второй половиной" после разрыва отношений, жестокость, суицидальные сообщения, издевательства, оскорбления, нарушения конфиденциальности и авторских прав - не включены в отчет.

Компании по-прежнему необходимо принимать решения о том, как классифицировать различные уровни контента, например, анимационные изображения эксплуатации детей.

"Мы больше сосредоточены на защите детей, чем на выяснении, какую именно классификацию мы опубликуем в отчете", - заявил Шульц.

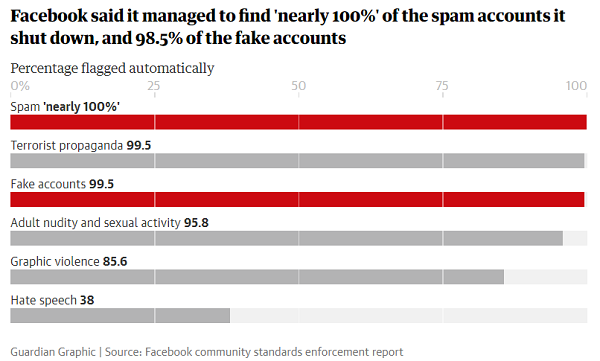

Facebook также удалось увеличить объем контента, зафиксированного с помощью новых инструментов на основе ИИ, которые социальная сеть использовала для поиска и модерации содержания без требования от пользователей отмечать его как подозрительное. Наибольший результат эти инструменты принесли, работая с фейковыми аккаунтами и рассылкой спама: Facebook заявил, что компания обнаружила и заблокировала 98,5% поддельных профилей и почти 100% спама.

По словам Шульца, автоматическая пометка была особенно эффективна для фотографий обнаженного тела, поскольку технологии распознавания изображений была понятно, что нужно искать. Сложнее было с агрессивными высказываниями из-за необходимости учитывать контекстуальные подсказки. "Мы обнаружили и удалили около 38% контента прежде, чем нам об этом сообщили пользователи", - прокомментировали в Facebook.

За последние несколько месяцев Facebook предпринял меры по повышению прозрачности. В апреле компания обнародовала руководство, что можно и нельзя публиковать на сайте. Также теперь политические рекламодатели должны пройти процесс аутентификации.

Данные модерации Facebook появились через неделю после выпуска Santa Clara Principles – свода правил и рекомендаций по модерации контента для крупных платформ. В Santa Clara Principles утверждается, что социальные сети должны публиковать количество удаляемых постов, предоставлять подробную информацию пользователям, содержимое профилей которых удаляется, при этом компания должна объяснить, почему, а также предложить возможность обжаловать это решение.

"Это замечательно как для первого шага. Тем не менее, у нас все еще нет представления о численности ошибок - сколько апелляций подано. Мы также хотели бы улучшить обмен сообщениями с пользователями о действиях, предпринятых к их учетной записи", - прокомментировал Джиллиан Йорк из Electronic Frontier Foundation.

Facebook - это не единственная платформа, которая двигается в направлении обеспечения прозрачности. В прошлом месяце YouTube сообщил, что он удалил 8,3 млн видео в период с октября по декабрь.

"Я считаю, что это прямой ответ на давление, которое такие компании испытывают в течение нескольких лет от различных заинтересованных сторон, включая группы гражданского общества и ученых", - заявил Йорк.